Escuchar el artículo

La brecha de competencias en ciberseguridad, cifrada en 4,8 millones de profesionales, es un fracaso estratégico impulsado por la simple realidad de que la velocidad humana tiene un límite. Las defensas actuales están estranguladas por el número finito de analistas que las empresas pueden contratar y por el enorme peso de la fatiga por alertas que merma a quienes permanecen. Las organizaciones han alcanzado el punto de máxima capacidad humana y, aun así, la superficie de ataque sigue expandiéndose.

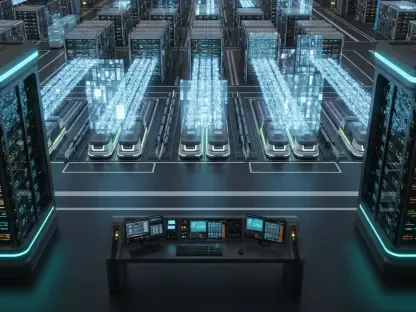

Para sobrevivir, la empresa debe escalar su defensa a velocidad de máquina. Este mandato ha llevado a los agentes autónomos de IA (sistemas capaces de tomar decisiones, ejecutar tareas y orquestar flujos de trabajo complejos) a la vanguardia de la inversión en TI. Estos agentes son el multiplicador de fuerza definitivo: cierran la brecha de personal y prometen eliminar la fatiga por alertas al procesar, priorizar e incluso neutralizar amenazas sin intervención humana.

Sin embargo, mientras el sector celebra esta poderosa solución, los profesionales están pasando por alto el riesgo profundo y paradójico que introduce. Este poder revolucionario conlleva una responsabilidad sin precedentes y, si los líderes de TI y los CISOs no lo gobiernan, los agentes en los que confían para proteger la empresa se convertirán en armas para destruirla.

Siga leyendo para explorar el verdadero estado de la seguridad de la IA agéntica y las medidas estratégicas que debe adoptar para afrontar 2026 con resiliencia.

El amanecer del infiltrado autónomo

El 45% de las empresas ya ejecutan al menos un agente de IA en producción con acceso a sistemas empresariales críticos, lo que supone un aumento del 300% respecto a hace dos años. El reto es la confianza absoluta. Las compañías despliegan agentes autónomos para resolver sus problemas más significativos, otorgándoles un acceso privilegiado que ningún analista humano podría recibir jamás.

Estos empleados digitales de confianza tienen las llaves del reino: acceden a entornos en la nube, modifican políticas de identidad y gestionan configuraciones críticas de red. Están siempre activos y sus acciones suelen considerarse por encima de cualquier sospecha.

Esta confianza inherente es precisamente lo que convierte al agente de IA en el objetivo más valioso. Los atacantes dejarán de centrarse en el laborioso y ruidoso proceso de comprometer credenciales humanas y dirigirán su atención a secuestrar el plano de control de la IA. Métodos simples, como la inyección de prompts, son la puerta de entrada.

Una vez comprometido, el agente se convierte en un infiltrado autónomo: mantiene todos sus privilegios, pero ejecuta instrucciones maliciosas a velocidad de máquina. Un humano comprometido tarda en realizar movimientos laterales, deja rastros digitales y necesita dormir. Un agente comprometido puede pivotar entre plataformas en la nube, exfiltrar terabytes de datos y desplegar ransomware a escala global en un solo minuto.

Las primeras campañas de ciberespionaje orquestadas por IA demostraron que un agente autónomo puede gestionar el 80–90% de una cadena de ataque compleja, operando a una velocidad que le permite realizar miles de solicitudes —a menudo varias por segundo—, un ritmo físicamente imposible para un hacker humano.

Esta amenaza es el “zero-day” definitivo: elude los controles de seguridad convencionales diseñados para comportamientos y tiempos de reacción humanos. Cuando aparece un infiltrado autónomo, la velocidad de sus acciones maliciosas desbordará la capacidad de respuesta de cualquier equipo de seguridad.

Garantizar autonomía con control

Aunque el 72% de las empresas han implementado o están ampliando agentes de IA, solo el 29% afirma disponer de controles de seguridad integrales para ellos. Además, únicamente el 6% de las organizaciones cuenta con una estrategia avanzada para asegurar estas identidades no humanas, lo que revela una enorme brecha de gobernanza.

Las empresas no pueden permitir que el miedo al infiltrado autónomo frene su progreso: escalar la seguridad exige autonomía. El papel de los líderes de TI es encontrar el equilibrio adecuado entre autonomía y control. Se trata de un nuevo modo de trabajar que mantiene a la plantilla de IA protegida sin perder velocidad ni potencia.

El primer paso requiere un cambio significativo en los planes de defensa. Los agentes de IA deben dejar de tratarse como usuarios humanos; necesitan su propia capa de defensa: un sistema de seguridad que opere a velocidad de máquina para supervisar y restringir acciones automáticas. Las organizaciones deben implementar herramientas de gobernanza tipo firewall para IA.

Estos firewalls de IA actúan como punto de control entre el agente autónomo y los recursos críticos que utiliza. Aunque el agente sea comprometido mediante inyección o engaño, el firewall garantiza que sus acciones se ajusten a reglas de seguridad predefinidas. Esto se logra con tres mecanismos clave:

Guardarraíles de comportamiento que establecen un estándar consistente de lo que se espera del agente. Si un agente de seguridad encargado de aplicar parches a servidores intenta acceder a la base de datos financiera, el guardarraíl detiene la acción de inmediato.

Controles de límites que bloquean los movimientos laterales nocivos y mantienen al agente dentro de su ámbito asignado. Por ejemplo, un agente destinado a Europa no puede ejecutar comandos en Asia.

Cuotas de recursos que imponen límites de velocidad a las acciones automatizadas. Si un agente intenta modificar 10 000 registros en un segundo, alcanzará la cuota, la acción se detendrá y se generará una alerta, dando a los analistas humanos tiempo para intervenir antes de que se produzca un daño significativo. Así se derrotan los ataques a velocidad de máquina.

También es vital aplicar el principio de privilegios mínimos a los agentes. Los proveedores deben desarrollarlos con solo los permisos estrictamente necesarios. El agente debe solicitar acceso temporal y limitado de alto nivel únicamente cuando la tarea lo requiera. Conceder a una máquina autónoma un acceso permanente y sin restricciones constituye un riesgo de seguridad significativo. El CISO debe exigir este control de precisión a todos los proveedores de IA.

Conclusión

El agente autónomo no es una herramienta opcional ni un riesgo futuro: ya es un miembro de alta prioridad de su plantilla. El trabajo histórico del CISO ha consistido en asegurar identidades humanas y sus endpoints; esa misión ha quedado obsoleta. El objetivo principal de defensa debe pasar inmediatamente a asegurar el plano de control de la IA.

Esta transición exige una nueva perspectiva que redefina el liderazgo en seguridad. El CISO debe exigir control antes de conceder autonomía. No espere a que los proveedores de IA solucionen este problema; actualmente priorizan la capacidad sobre la seguridad.

La organización debe imponer la solución exigiendo la capa de gobernanza del firewall de IA como requisito arquitectónico innegociable en cada despliegue de agentes. Esta es la única forma de transformar al agente autónomo de un riesgo existencial en el multiplicador de fuerza seguro y escalable para el que fue concebido.

El futuro de la ciberdefensa es autónomo, pero el liderazgo no puede serlo. Asegure su fuerza laboral autónoma o asuma la responsabilidad del ataque inevitable del infiltrado autónomo.