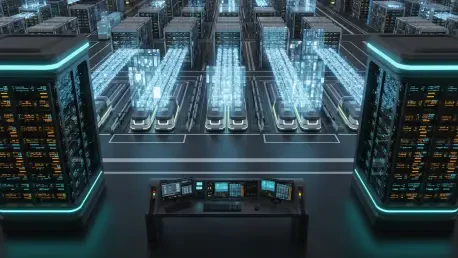

La industria tecnológica ha alcanzado un punto de inflexión crítico donde la inteligencia artificial ya no se limita exclusivamente a procesar texto o imágenes en un entorno puramente virtual, sino que comienza a interactuar de manera directa con la complejidad infinita del mundo físico tangible. NVIDIA ha respondido a este desafío mediante la presentación de su Physical AI Data Factory Blueprint, una arquitectura de referencia abierta diseñada para transformar radicalmente el desarrollo de la robótica avanzada y los sistemas autónomos en todo el planeta. Esta propuesta no es simplemente una actualización de software, sino un mapa estratégico integral que permite a las organizaciones automatizar por completo la creación, el escalado y la validación de los datos necesarios para que las máquinas comprendan y respondan a las leyes físicas en tiempo real. Al abordar la escasez de datos de entrenamiento de alta calidad, esta infraestructura facilita la superación de obstáculos técnicos que anteriormente limitaban el progreso de la robótica industrial y comercial.

La Base TecnológicEl Ecosistema Cosmos y la Validación Física

El núcleo operativo de esta ambiciosa propuesta se fundamenta en el ecosistema NVIDIA Cosmos, una infraestructura modular que utiliza modelos de mundo abierto para convertir flujos de información limitados en conjuntos masivos de datos diversificados. Dentro de este esquema, el componente denominado Cosmos Curator desempeña una función esencial al encargarse de la curaduría e investigación inicial de los archivos, procesando y refinando tanto los datos provenientes del mundo real como aquellos generados de forma sintética. Este proceso garantiza que la base de conocimientos sea coherente y esté correctamente etiquetada antes de avanzar hacia fases más complejas del entrenamiento. Posteriormente, el módulo Cosmos Transfer interviene para amplificar exponencialmente estos datos seleccionados, permitiendo que los sistemas capturen escenarios de baja frecuencia que son fundamentales para garantizar la seguridad en entornos operativos reales, donde cualquier error mínimo podría tener consecuencias materiales graves para la maquinaria.

La precisión técnica de esta arquitectura se consolida a través del Cosmos Evaluator, una herramienta que supervisa automáticamente que toda la información generada cumpla estrictamente con las leyes fundamentales de la física. Este proceso de filtrado y puntuación resulta vital para evitar que los robots aprendan comportamientos erróneos en simulaciones virtuales que no podrían replicarse de manera segura en el suelo de una fábrica o en una vía pública. Al centrarse en la captura de los denominados casos extremos, que son situaciones peligrosas o inusuales difíciles de registrar manualmente en el mundo real, NVIDIA proporciona a los desarrolladores una ventaja competitiva sin precedentes. Esta metodología asegura que los modelos resultantes no solo sean inteligentes en un sentido lógico, sino que posean una comprensión profunda del movimiento, la inercia y la interacción táctil, elementos que definen la verdadera frontera de la inteligencia artificial física contemporánea en el sector industrial.

Optimización OperativOrquestación Mediante NVIDIA OSMO

Para mitigar la creciente complejidad técnica que conlleva gestionar infraestructuras de inteligencia artificial a gran escala, la compañía ha implementado NVIDIA OSMO como su marco de orquestación de código abierto definitivo. Este sistema permite unificar flujos de trabajo en diversos entornos informáticos, desde nubes públicas hasta centros de datos locales de alta densidad, eliminando de forma efectiva las tareas manuales repetitivas que suelen ralentizar la innovación tecnológica. Mediante esta herramienta, los ingenieros pueden coordinar la ingesta de datos, el entrenamiento de modelos y la validación en un único proceso continuo y fluido que optimiza el uso de los recursos de computación disponibles. La capacidad de OSMO para gestionar de manera proactiva los cuellos de botella técnicos garantiza que el ciclo de desarrollo de un robot autónomo se reduzca significativamente, permitiendo que las empresas pasen de la fase de prototipo a la implementación comercial con una agilidad que antes se consideraba imposible de alcanzar.

La integración de agentes de codificación avanzados representa otro pilar fundamental en la automatización de estos flujos operativos, permitiendo una sinergia fluida con herramientas líderes como OpenAI Codex o Claude Code. Esta colaboración facilita una operación de inteligencia artificial nativa, donde los propios agentes gestionan los recursos de computación y resuelven problemas técnicos complejos de forma autónoma bajo la supervisión de los especialistas. Al vincular intrínsecamente la programación con la creación de datos de alta fidelidad, se establece un ecosistema donde la computación se convierte en la materia prima esencial para la generación de inteligencia. Este enfoque no solo mejora la eficiencia del desarrollo, sino que también democratiza el acceso a capacidades avanzadas de robótica para organizaciones que carecen de infraestructuras de soporte masivas. La orquestación inteligente asegura que cada ciclo de procesamiento contribuya directamente a la mejora continua del modelo físico, acelerando el aprendizaje profundo de las máquinas.

Expansión Global: Colaboraciones Estratégicas y Hardware de Vanguardia

El despliegue efectivo de esta arquitectura de referencia ha sido posible gracias a una serie de alianzas estratégicas con gigantes de la computación en la nube como Microsoft Azure y proveedores especializados como Nebius. Estas plataformas han integrado el blueprint de NVIDIA en sus cadenas de herramientas existentes, permitiendo que los desarrolladores utilicen servicios de gestión de datos y operaciones de internet de las cosas para entrenar sistemas de inteligencia artificial física a escala corporativa. La infraestructura subyacente se apoya en hardware de última generación, específicamente en los servidores equipados con las GPU Blackwell de NVIDIA, que ofrecen la potencia necesaria para manejar modelos de visión y lenguaje de gran tamaño. Esta capacidad de procesamiento masivo es lo que permite que empresas de diversos sectores puedan simular realidades complejas con una latencia mínima, garantizando que el entrenamiento de los agentes autónomos se realice bajo los estándares más exigentes de rendimiento y fiabilidad técnica.

En el ámbito de las aplicaciones prácticas, organizaciones de renombre como Uber y Skild AI han comenzado a utilizar estas herramientas para perfeccionar sus sistemas de conducción autónoma y robots de uso general. La tendencia actual muestra cómo la simulación avanzada y el aprendizaje por refuerzo están permitiendo superar las barreras tradicionales de costo y tiempo que históricamente frenaron el avance de la autonomía total. En el sector industrial, empresas especializadas en visión artificial están empleando esta arquitectura para mejorar la precisión de sus agentes en entornos de manufactura dinámicos y altamente impredecibles. La convergencia entre la generación de datos sintéticos y la validación física ha creado un nuevo estándar en la industria, donde la capacidad de prever situaciones críticas en el mundo virtual se traduce directamente en una mayor seguridad operativa. Esta colaboración global está sentando las bases para una economía robótica donde la eficiencia productiva se incrementa de forma exponencial.

El Camino Hacia la Autonomía Total: Conclusiones y Próximos Pasos

La presentación de esta infraestructura integral demostró que el desarrollo de la inteligencia artificial física dejó de ser un proceso artesanal para convertirse en una operación industrial escalable y eficiente. A través de la automatización del ciclo de vida de los datos, las organizaciones consiguieron eliminar las limitaciones geográficas y logísticas que anteriormente impedían la captura de información de entrenamiento de alta calidad en entornos reales. La implementación de modelos de mundo abierto y sistemas de orquestación proactiva permitió que los desarrolladores se concentraran en la innovación de aplicaciones finales en lugar de en la gestión técnica de servidores. Los resultados obtenidos hasta el momento confirmaron que la precisión física en las simulaciones es el factor determinante para el éxito de los sistemas autónomos modernos, reduciendo drásticamente los riesgos de implementación en infraestructuras críticas y mejorando la aceptación social de estas tecnologías en la vida cotidiana.

Para avanzar hacia una adopción masiva, resultó indispensable que las empresas comenzaran a integrar estas arquitecturas abiertas en sus procesos internos de diseño y manufactura desde las fases más tempranas. La inversión en talento especializado capaz de supervisar agentes de codificación y gestionar fábricas de datos se perfiló como la prioridad principal para los líderes del sector tecnológico. En lugar de limitarse a la recopilación pasiva de información, las organizaciones debieron adoptar una mentalidad de generación computacional de datos, donde la simulación se convirtió en el laboratorio principal de pruebas. El éxito futuro de la robótica dependió entonces de la capacidad de estas entidades para colaborar en ecosistemas abiertos que fomentaran la interoperabilidad entre diferentes plataformas de nube y hardware. De este modo, la transición hacia una sociedad con sistemas autónomos integrados se consolidó mediante una base técnica sólida, transparente y alineada con las exigencias del mundo físico real.