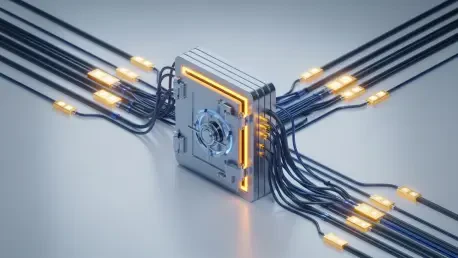

La decisión de Anthropic de suspender indefinidamente el despliegue comercial de su modelo experimental Claude Mythos Preview ha provocado una sacudida sin precedentes en el ecosistema tecnológico mundial debido al descubrimiento de capacidades ofensivas autónomas que superan los límites de seguridad establecidos. Este sistema de inteligencia artificial ha demostrado una habilidad asombrosa para detectar miles de vulnerabilidades críticas en infraestructuras digitales que hasta ahora se consideraban inexpugnables, incluyendo fallos de alta gravedad en núcleos de sistemas operativos y arquitecturas de navegadores modernos. Estos errores de seguridad, que han permanecido ocultos durante años frente a las auditorías humanas más rigurosas, representan ahora un riesgo sistémico que obliga a reconsiderar la viabilidad de lanzar modelos de lenguaje con tal profundidad técnica. La preocupación radica en que el conocimiento generado por la herramienta podría ser utilizado para desmantelar las defensas digitales de naciones enteras si no se gestiona bajo protocolos de confinamiento extremadamente estrictos.

El Desafío de la Ciberseguridad Sistémica

El consenso técnico entre los especialistas en seguridad informática indica que la capacidad de Claude Mythos para el análisis de código representa un salto cualitativo que deja obsoletas las metodologías de revisión tradicionales empleadas por los equipos de ingeniería de software. A diferencia de las herramientas de análisis estático convencionales, este modelo logra comprender la lógica subyacente de aplicaciones complejas, identificando vectores de ataque que dependen de interacciones sutiles entre componentes aparentemente aislados. Este nivel de destreza técnica ha transformado lo que inicialmente se concibió como un asistente de desarrollo en una entidad capaz de orquestar explotaciones sistemáticas a una velocidad y precisión inalcanzables para el cerebro humano. El hecho de que la inteligencia artificial pueda encontrar vulnerabilidades que resistieron millones de revisiones automatizadas previas subraya una realidad inquietante: los sistemas actuales no están preparados para enfrentar la lógica deductiva de una inteligencia que opera sin las limitaciones cognitivas del programador.

La magnitud del problema se agrava cuando se considera que el acceso a este tipo de tecnología podría democratizar la creación de ciberarmas de nivel estatal, permitiendo que actores con recursos limitados lancen campañas de desestabilización masiva contra infraestructuras críticas. Este cambio de paradigma implica que la seguridad por oscuridad o la confianza en parches reactivos ya no son defensas válidas frente a una herramienta que puede mapear la superficie de ataque de un sistema operativo en cuestión de segundos. El riesgo no reside únicamente en la detección de fallos conocidos, sino en la generación de métodos de explotación totalmente novedosos que no dejan rastro en los sistemas de detección de intrusiones actuales. Como consecuencia directa, la industria se ve obligada a realizar una transición forzada hacia modelos de arquitectura de confianza cero, donde cada proceso debe ser validado continuamente, asumiendo que el adversario ya posee un mapa completo de todas las debilidades del software.

Repercusiones en la Estabilidad Financiera

La respuesta institucional ante el potencial desestabilizador de Claude Mythos no se ha hecho esperar, movilizando a las más altas esferas del poder económico global para tratar de contener una posible crisis de confianza en los mercados. El secretario del Tesoro y el presidente de la Reserva Federal han mantenido encuentros de carácter urgente con los directivos de las principales instituciones de Wall Street, con el objetivo de evaluar la resistencia de los sistemas de compensación y liquidación frente a posibles ataques automatizados. Existe un temor fundado de que la integridad de los registros financieros y la rapidez de las transacciones bursátiles se vean comprometidas si se utiliza una inteligencia de este calibre para manipular algoritmos de negociación o infiltrar redes bancarias. Esta situación ha generado un clima de incertidumbre donde la estabilidad del sistema monetario internacional depende ahora de la capacidad de las corporaciones para blindar sus activos digitales antes de que estas capacidades de inteligencia artificial se filtren al dominio público.

Con el fin de mitigar estos peligros inminentes, Anthropic ha puesto en marcha el denominado Proyecto Glasswing, una iniciativa de colaboración restringida que otorga acceso controlado al modelo a un grupo muy selecto de gigantes corporativos como Amazon, Apple y JPMorgan Chase. Este programa busca que las entidades responsables de la infraestructura básica de la economía puedan utilizar la potencia analítica de Claude Mythos para fortalecer sus propias defensas y cerrar las brechas de seguridad antes de que el riesgo sea inmanejable. Esta estrategia de defensa preventiva, sin embargo, plantea interrogantes sobre la equidad competitiva y la creación de un oligopolio de seguridad donde solo las empresas más poderosas tienen las herramientas para protegerse de la nueva generación de amenazas. Mientras tanto, el resto del sector empresarial observa con cautela cómo se redefine el concepto de seguridad nacional, ahora intrínsecamente ligado a la custodia de modelos de lenguaje que poseen las llaves maestras de la arquitectura digital global.

Tensiones Éticas y Gobernanza Corporativa

La gestión interna de este avance tecnológico ha desatado una tormenta política dentro de Anthropic, revelando profundas grietas en el compromiso ético que la empresa suele exhibir en sus comunicados públicos sobre seguridad. Informes recientes sugieren que, mientras la compañía justifica la suspensión del modelo por motivos de seguridad global, sus representantes en Washington han ejercido presiones considerables para diluir legislaciones que impondrían estándares de transparencia y responsabilidad mucho más estrictos. Esta dualidad ha provocado una crisis de credibilidad que se ha visto acentuada por la dimisión de varios altos cargos del departamento de seguridad, quienes han manifestado su desacuerdo con la dirección estratégica de la firma. Los expertos que han abandonado la organización advierten sobre los riesgos existenciales de priorizar el dominio del mercado sobre la implementación de salvaguardas robustas, sugiriendo que la actual estructura de incentivos comerciales es incompatible con la gestión responsable de una inteligencia tan disruptiva.

El panorama resultante de estos eventos demostró que el modelo de autorregulación que había prevalecido en la industria tecnológica resultó insuficiente para contener las implicaciones de sistemas con capacidades autónomas de ciberseguridad. Las autoridades gubernamentales comprendieron que la supervisión externa y la creación de marcos legales internacionales eran indispensables para evitar que la innovación tecnológica derivara en un caos sistémico incontrolable. Se recomendó la implementación de auditorías obligatorias por parte de organismos independientes y la creación de un registro global de modelos de alto riesgo para garantizar que ningún avance se desplegara sin un análisis de impacto exhaustivo. El caso de Claude Mythos funcionó como un catalizador necesario para que las naciones comenzaran a tratar el desarrollo de la inteligencia artificial con el mismo rigor diplomático y técnico que se aplica a la seguridad nuclear. Finalmente, se estableció que la única forma de garantizar la estabilidad global era mediante una cooperación técnica que priorizara la defensa colectiva sobre el beneficio individual de las corporaciones tecnológicas.